研究人员使用GPU训练的神经网络为耳塞用户提供背景噪音的“静音按钮”

多亏了耳塞,您可以在做任何事情的同时随时随地打电话。问题是:电话另一端的人也听到了这一切,从你室友的吸尘器到你工作的咖啡馆的背景对话。

现在,华盛顿大学的三位研究生一起度过了新冠疫情,他们一起在一个嘈杂的公寓里度过,让电话另一端的人只听到你的声音——而不是你周围发生的所有事情。

用户发现,该系统被称为“ClearBuds”——上个月在 ACM 移动系统、应用程序和服务国际会议上提出——比市售替代品更好地改善了背景噪声抑制。

“你正在删除你的音频背景,就像你在视频通话中删除你的视觉背景一样,”Paul G. Allen 计算机科学与工程学院的博士生 Vivek Jayaram 解释说。

华盛顿大学的所有计算机科学与工程专业研究生 Maruchi Kim、Ishan Chatterjee 和 Jayaram 在三位室友合着的论文中概述了 ClearBuds 与其他无线耳塞在两个方面的不同之处。

3D 打印耳塞外壳前面的 ClearBuds 硬件(圆盘)。

首先,ClearBuds 每个耳塞使用两个麦克风。

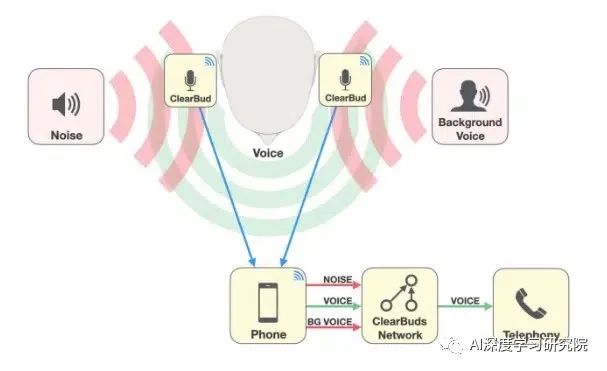

虽然大多数耳塞在同一个耳塞上使用两个麦克风,但 ClearBuds 使用两个耳塞的麦克风并创建两个音频流。

这为系统创造了更高的空间分辨率,以更好地分离来自不同方向的声音,Kim 解释说。换句话说,它使系统更容易识别耳塞佩戴者的声音。

其次,该团队创建了一种可以在手机上运行的神经网络算法来处理音频流,以确定哪些声音应该被增强,哪些应该被抑制。

研究人员依靠两个独立的神经网络来做到这一点。

第一个神经网络抑制所有不是人声的东西。

第二个增强了说话者的声音。可以识别扬声器,因为它同时来自两个耳塞中的麦克风。

ClearBuds 通过使用一对无线同步耳塞执行语音分离,将用户的语音与背景噪音隔离开来。

资料来源:华盛顿大学 Maruchi Kim

虽然研究人员创建的软件足够轻巧,可以在移动设备上运行,但他们依靠 NVIDIA TITAN 桌面 GPU 来训练神经网络。他们使用合成音频样本和真实音频。培训用了不到一天的时间。

用户报告说,结果明显好于市售的耳塞,这些结果在全行业赢得了认可。

该团队在上个月的 ACM MobSys 2022 会议上获得了最佳论文的第二名。除了 Kim、Chatterjee 和 Jayarm,该论文的合著者还包括艾伦学院的副教授Ira Kemelmacher-Shlizerman ;Shwetak Patel,艾伦学院和电气与计算机工程系的教授;以及艾伦学院的两位教授Shyam Gollakota和Steven Seitz 。

可以肯定的是,论文中概述的系统不能立即采用。虽然许多耳塞的每个耳塞都有两个麦克风,但它们只能从一个耳塞流式传输音频。行业标准正赶上处理来自耳塞的多个音频流的想法。

尽管如此,研究人员希望他们的开源工作能够激励其他人将神经网络和麦克风结合起来,以提供更高质量的音频通话。

Kim 说,这些想法还可以用于隔离和增强通过智能扬声器进行的对话,将它们用于临时麦克风阵列,甚至跟踪机器人位置或搜索和救援任务。

BRIAN CAULFIELD